En esta entrada quiero contar algo muy básico y corto: ¿cómo puedo montar un modelo de IA de forma local y qué beneficios tiene hacerlo?

Lo primero que tenemos que hacer es comprobar si contamos con los requisitos necesarios para ello. Para eso debemos entender qué recursos computacionales demandan los modelos para poder funcionar.

- Un ordenador: Obvio, no necesito explicarlo más.

- Almacenamiento: Esto es esencial; un modelo local ocupa espacio. Si no podemos guardarlo, no podemos usarlo. Esto puede ir desde unos pocos gigas hasta cientos de gigas.

- Capacidad de cómputo (CPU y/o GPU): Los modelos suelen estar optimizados para correr en tarjetas gráficas, especialmente de NVIDIA, pero eso no implica que no puedan usarse en una CPU común o en una tarjeta de vídeo antigua. Aquí lo importante es hacer el match entre el modelo correcto y nuestro hardware. Más adelante te proporcionaré una herramienta para ello.

- Memoria RAM: Cuando comenzamos a conversar con nuestro LLM o LMM vamos haciendo uso del contexto (la conversación). A medida que este crece, el coste de procesarlo aumenta de forma más que lineal y se va almacenando en la memoria temporal del ordenador; por eso, mayor RAM, mejor rendimiento.

Todos estos elementos se combinan para determinar el rendimiento, que normalmente medimos en tokens/segundo: la cantidad de “palabras” (entre comillas, porque una palabra no es exactamente un token) que nuestro modelo puede predecir cada segundo.

Hay muchas maneras de ejecutar LLM o LMM en local. En este artículo voy a exponer una muy gráfica y sencilla, y te mencionaré otras alternativas para que puedas experimentar por tu cuenta.

Iniciando con LM Studio

Vamos con un programa muy sencillo: LM Studio. Es una app gráfica que te permite descargar modelos, chatear con ellos y experimentar sin tocar una línea de código, además con las posibilidades de experimentar sin romper cosas.

Actualmente es una de las formas que utilizo para experimentar con Agentes y no tener que gastarme dinero con las API keys de los proveedores en la nube. Lo uso sobre un MacBook Air M4 con 16 GB RAM sin problemas para los modelos compatibles.

Pasos para instalar LM Studio

1. Descarga e instala la app de LM Studio desde lmstudio.ai, al finalizar deberías tener una ventana como esta:

Imagen 1. LM Studio

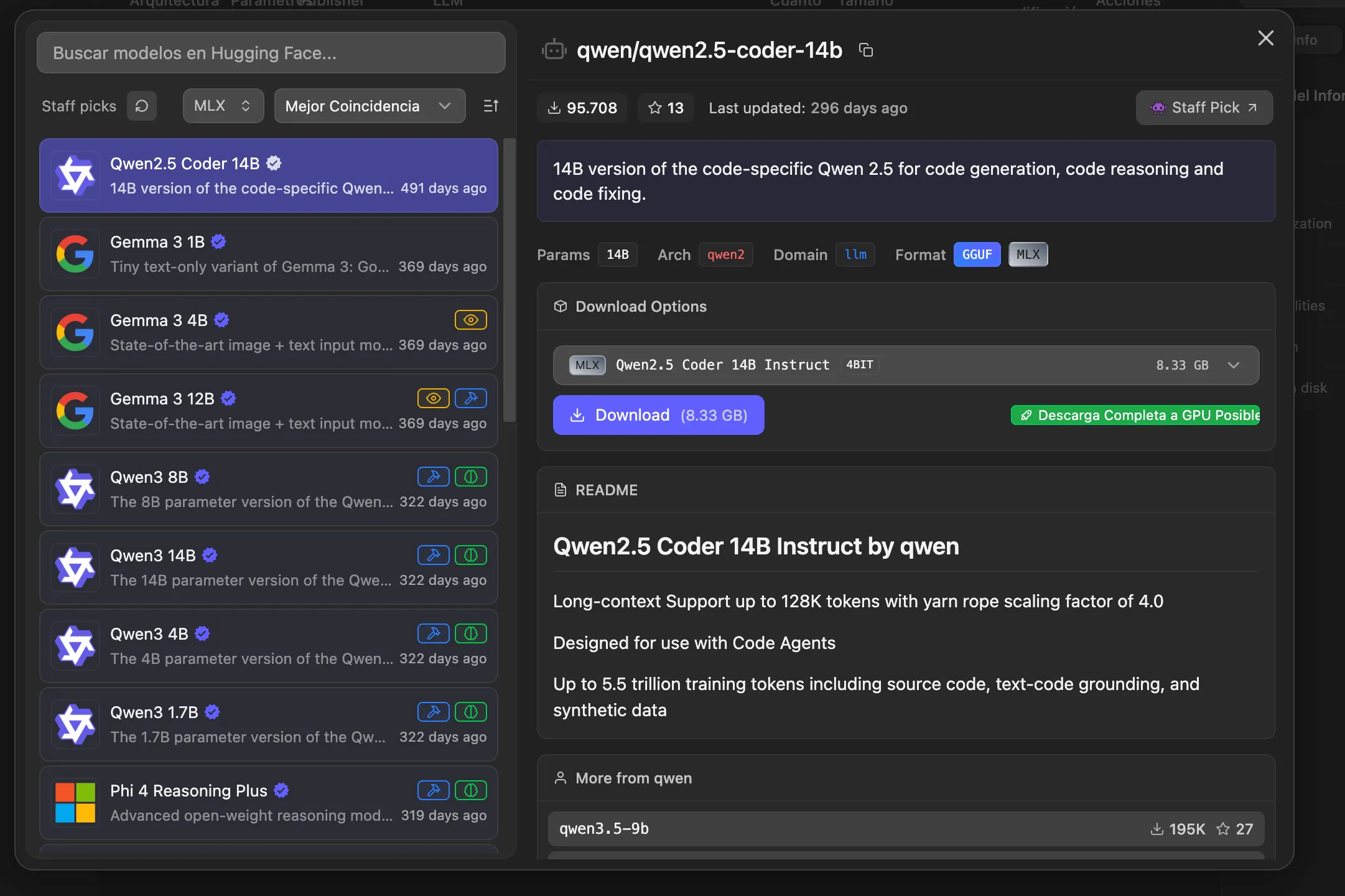

2. Instalemos nuestro primer modelo local. Vamos a la pestaña Model search (el último icono con el robot). Nos aparecerá una ventana como esta:

Imagen 2. Búsqueda de modelos en LM Studio

Aquí pasa algo maravilloso con esta aplicación. Gráficamente nos ordenará todos los modelos compatibles con nuestro hardware. Además nos dirá si los modelos tienen capacidad de aceptar tools (icono de martillo), hacer thinking (icono de cerebro) o incluso recibir archivo, manejar imágenes o audios (icono de ojo).

Ten en consideración varias cosas en este apartado:

- Los modelos que aparecen son de código abierto, no pretendas encontrar algún modelo de Anthropic por ejemplo.

- A más parámetros (se usa la letra B, y se lee como billones de parámetros) es más inteligente el modelo, pero a mayor cantidad de parámetros más consumo de memoria de almacenamiento y RAM.

- Lo ideal es escoger un modelo que nos funcione para lo que queremos hacer, no hace falta que sea el más grande. Hay que tener en cuenta que los parámetros de entrenamiento entre los modelos no son los mismos. Hay modelos como los Phi enfocados en STEM y otros como Gemma o los Qwen para uso genérico.

3. Descarga un modelo pequeño para empezar y probar (recomiendo el Qwen 3.5 de 2B que apenas pesa 2,2 GB).

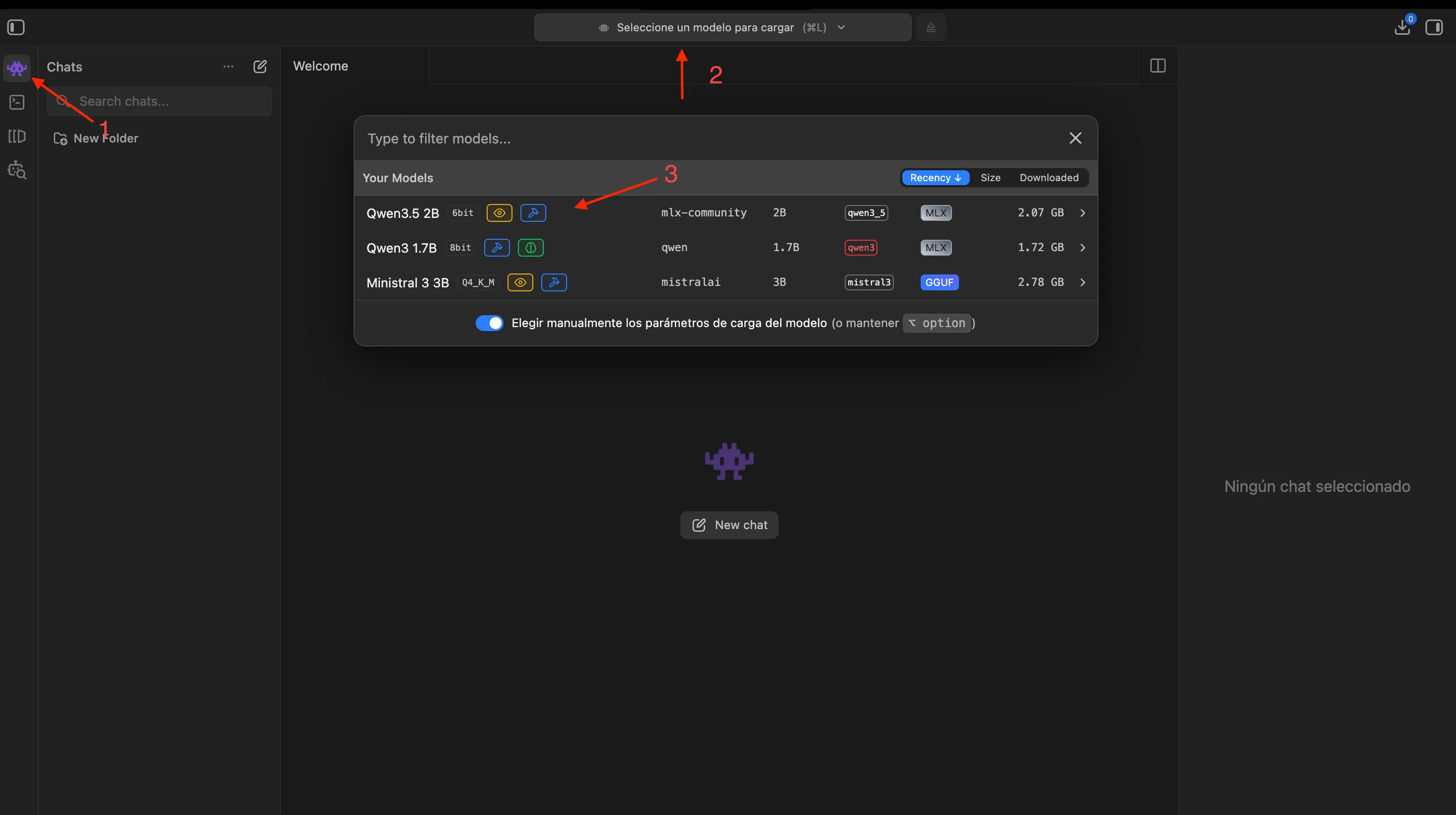

4. Una vez finalizada la descarga, vamos a cargar el modelo y comenzar a chatear. Para ello, primero accedemos a la pestaña de chat. Luego, nos dirigimos a la parte superior de la pantalla, donde se encuentra la opción “Cargar modelo”. A continuación, seleccionamos el modelo deseado y esperamos a que se cargue. ¡Y listo! Ya podemos empezar a chatear. Así de sencillo.

Imagen 3. Pasos para montar un modelo en LM Studio

5. Una vez finalizadas las pruebas, recuerda desmontar el modelo para liberar espacio en tu memoria.

Notas:

- Este programa ofrece una amplia gama de funcionalidades, con numerosos parámetros para interactuar con los modelos. Te animo a explorar estos parámetros para profundizar en tu comprensión de la IA.

- Si deseas comprobar la compatibilidad de los modelos con tu hardware sin utilizar LM Studio, te recomiendo encarecidamente esta herramienta excepcional: canirun.ai.

- Alternativamente, puedes instalar modelos sin necesidad de una interfaz gráfica utilizando el clásico ollama.

¿Por qué tener un LLM local?

En mi caso, además de aprender, me ha permitido crear un pequeño servidor para probar aplicaciones de agentes y observar sus respuestas. He creado un repositorio donde comparto mis conocimientos sobre orquestación de agentes y multiagentes. Si te interesa, puedes consultarlo aquí: multi-agent-book-projects.

Los beneficios más destacados de tener un LLM local incluyen:

- Costo cero.

- Privacidad total, ya que nada sale de tu máquina.

- Funcionamiento offline, sin necesidad de conexión a internet.

- La posibilidad de crear capacidades superiores con agentes para lograr automatizaciones.

Te animo a explorar este fascinante mundo, que sin duda es extremadamente adictivo. Como dice un buen amigo: IA = Insomnio + Ansiedad, pero en el buen sentido.